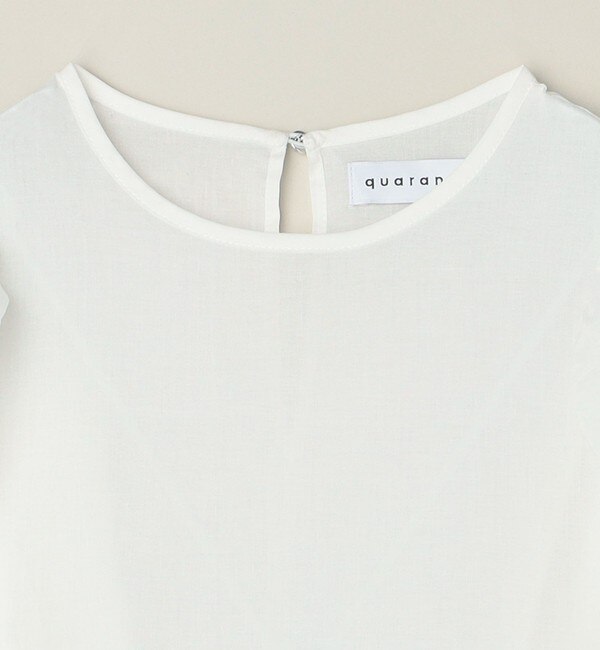

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス

(税込) 送料込み

商品の説明

2023AW

season thema「a study in chic」

-Design-

暑さの残る時期から活躍する、軽めの綿ボイル素材のブラウス。

風をはらむような袖のふくらみが印象的な一着です。

一枚着としてはもちろん、ジャケットなどとのレイヤード使いもおすすめ。

-Material-

軽い綿ボイル素材。

アウター等を羽織っても邪魔にならない素材感。

ご家庭で手洗い可能です。

-Styling-

ジャケットやライダースの裾からちらっと覗かせるレイヤードスタイルがおすすめ。

一枚着としても華やかで存在感のある一着です。

▼同素材アイテムもございます。

quaranciel: 〈手洗い可能〉ボイル ヨーク フリル シャツ(品番:611-14-0011)

※モールサイトによって(ハイフン/‐)抜きでの品番表記となります。

【quaranciel / カランシエル】

フランス語の「quarante(40)」と「ciel(空)」を掛け合わせた造語。

「BASIC TO CHIC(定番をシックに着る)」をコンセプトに、経験を積み重ねて磨かれた大人の女性だからこそ醸し出される、

ベーシックながらも上品で洗練されたスタイルを提案。

-------------------------------------

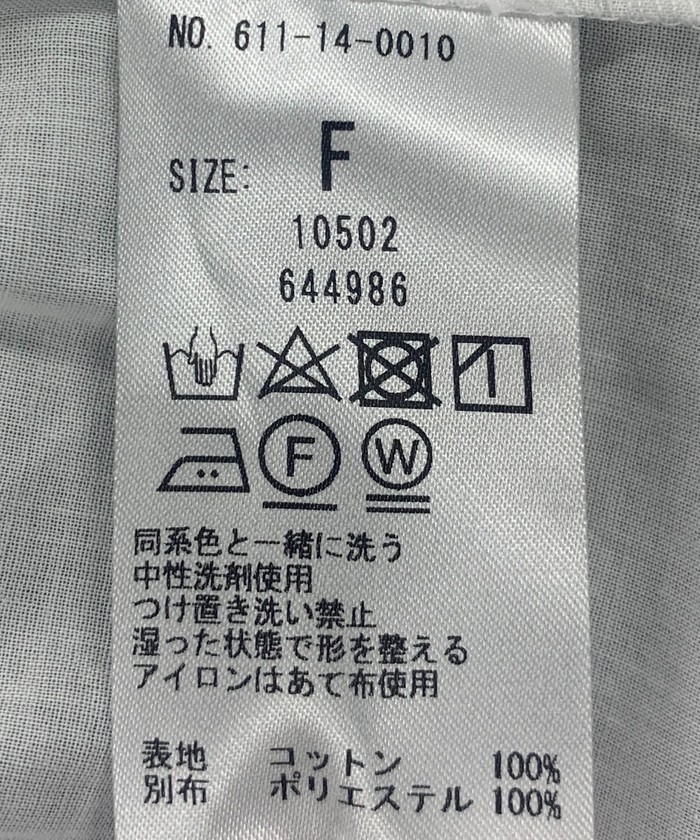

生地の厚み:薄手

伸縮性:無

透け感:やや有

光沢感:無

水洗い:可

-------------------------------------

【スタッフ着用コメント】

身長:162cm/体型:普通/普段サイズ:M/着用サイズ:ONE SIZE

サイズ感:身幅は余裕あり、着丈はやや後ろ下がりのデザインなのでヒップは隠れるサイズ。

袖は肘が隠れる長さなので、手首すっきりで腕時計やブレスレット等のアクセサリーが映えます。

-------------------------------------

詳細着用スタッフ:162cm 着用サイズ:ONE SIZE

※EC限定レーベルのため、店舗での展開はございません。

※汗や雨等の水分や摩擦により、他の衣類に色移りする場合がありますので、淡色衣類との組み合わせはご注意ください。

※着用、洗濯時のスレで表面が毛羽立ち白っぽくなる場合がありますのでご注意ください。

※屋外での撮影画像は、光の当たり具合で色味が多少異なって見える場合があります。商品の色味は、スタジオでの詳細画像をご参照ください。

※末永く愛用頂く為に、アテンションタグ・洗濯ネームを必ずご確認の上、着用又はお取り扱い下さい。

※画像の商品はサンプルです。

実際の商品と仕様、加工、サイズが若干異なる場合がございます。

‐‐公式Instagramではアイテム動画や新作情報をご覧いただけます‐‐

- 原産国

- -

- 素材

- 表地: コットン100%, 別布: ポリエステル100%

- 特徴

- 半端袖

- ミドル丈

- 無地

- コットン

- ノーカラー

- 関連カテゴリー

- トップス

- シャツ/ブラウス

- 性別タイプ

- レディース

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

SHIPS any:〈洗濯機可能〉レース ティアード シャツ ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈洗濯機可能〉サテン ボウタイ バイカラー ブラウス

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル Vヨーク フリル シャツ: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス | SHIPS

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス(505452641

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

SHIPS|quaranciel:<手洗い可能>ボイル ティアード ブラウス | Rakuten

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

SHIPS|quaranciel:<手洗い可能>ボイル Vヨーク フリル シャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス(505452641

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス(505452641

シャツ ブラウス quaranciel:〈手洗い可能〉ボイル ティアード

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

八木(SHIPS any 光が丘IMA店(SHIPS for women))|quarancielのシャツ

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス: シャツ

シャツ ブラウス quaranciel:〈手洗い可能〉ボイル ティアード

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

楽天市場】quaranciel:<手洗い可能>ボイル ティアード ブラウス

シャツ ブラウス quaranciel:〈手洗い可能〉ボイル ティアード

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

楽天市場】quaranciel:<手洗い可能>ボイル ティアード ブラウス

quaranciel:〈手洗い可能〉ボイル ティアード ブラウス|SHIPS(シップス

quaranciel:〈手洗い可能〉ボイル Vヨーク フリル シャツ

商品の情報

メルカリ安心への取り組み

お金は事務局に支払われ、評価後に振り込まれます

出品者

スピード発送

この出品者は平均24時間以内に発送しています